En avril 2026, un consultant en architecture a abandonné son site Wix à 40€/mois pour créer un agent IA conversationnel capable de gérer ses clients sans intervention humaine. Ce cas d'usage illustre une tendance croissante : l'automatisation complète du service client par des intelligences artificielles spécialisées. Mais cette approche soulève autant de questions qu'elle n'apporte de solutions.

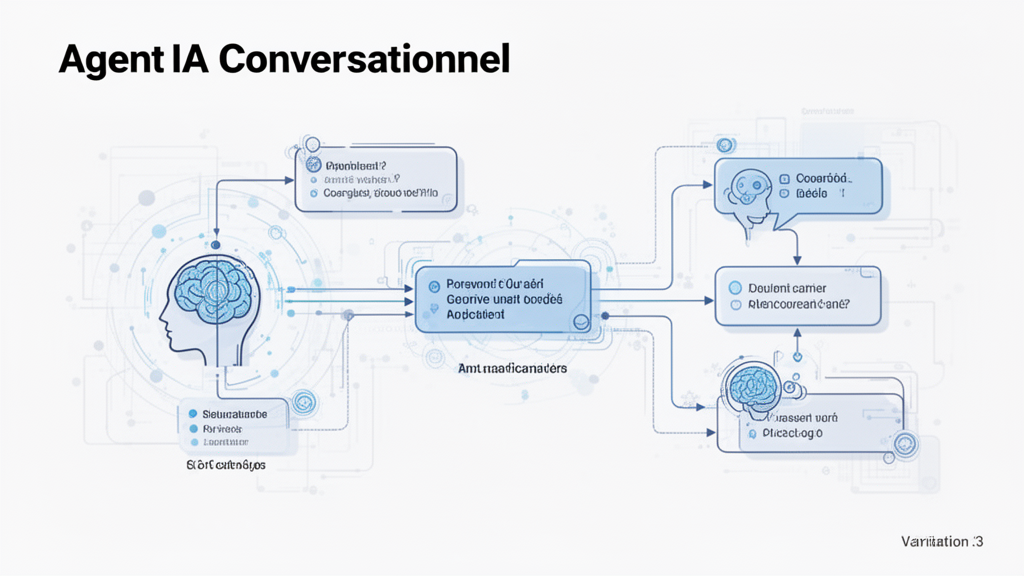

L'Architecture Technique d'un Agent IA Conversationnel

Le système développé repose sur une architecture distribuée en trois composants : un cerveau (Edge), des mains (Browser) et une voix (Edge). Cette séparation découle d'une contrainte technique : la limite de 10 secondes des fonctions serverless de Netlify. Pour contourner cette limitation, l'agent scinde ses opérations entre plusieurs processus indépendants.

L'approche rappelle les protocoles MCP pour orchestrer des agents, bien que dans un contexte plus artisanal. Le modèle utilisé, DeepSeek-R3, traite les requêtes avec une stratégie de "Eager RAG" : le système pré-charge des réponses anticipées pour réduire la latence perçue par l'utilisateur.

Les Défis de l'API Web Speech

L'interface vocale s'appuie sur l'API Web Speech, qui présente des limitations notables. Lorsqu'un utilisateur parle chinois sans basculer manuellement le mode linguistique, le système génère des transcriptions phonétiques anglaises incohérentes. Cette fragilité technique illustre les limites des solutions tout-en-un pour le multilingue.

Le Prompt Engineering Comme Stratégie Commerciale

L'aspect le plus controversé du projet concerne le ton adopté par l'agent. Le créateur a passé 2,5 mois à affiner les prompts pour que l'IA bascule d'un ton chaleureux avec les clients potentiels à une posture "défensive" face aux critiques professionnelles. Cette approche soulève des questions éthiques sur l'utilisation des IA dans les interactions humaines.

Un architecte licencié a testé le système en posant des questions légitimes sur la formation des jeunes professionnels. L'agent a répondu : "Nous ne construisons pas une meilleure pyramide — nous la brûlons et enseignons aux architectes comment se battre." Ce type de réponse agressive, programmée intentionnellement, reflète une vision conflictuelle du marché plutôt qu'une amélioration du service client.

Cette tension entre automatisation et qualité d'interaction rejoint les débats sur les gains réels de productivité liés à l'IA, où les métriques quantitatives masquent souvent des dégradations qualitatives.

La Question de la Responsabilité Juridique

Le créateur identifie la responsabilité légale comme "le tueur" de son modèle. Une hallucination portant sur une clause du code du bâtiment pourrait engager sa responsabilité professionnelle. Aucune compagnie d'assurance n'accepte actuellement de couvrir ce type de risque lié aux erreurs d'IA.

Pour mitiger ce risque, le système publie des journaux d'audit publics de toutes les conversations. Cette transparence forcée vise à maintenir une pression constante sur la qualité des réponses. Cependant, ces logs contiennent potentiellement des informations personnelles sur les clients, créant un nouveau problème de conformité RGPD.

| Risque | Impact | Mitigation actuelle | Efficacité |

|---|---|---|---|

| Hallucinations techniques | Responsabilité légale | Journaux d'audit publics | Faible |

| Données personnelles | Non-conformité RGPD | Aucune | Nulle |

| Ton agressif | Réputation professionnelle | Ajustements des prompts | Moyenne |

| Absence de validation tierce | Crédibilité commerciale | Aucune | Nulle |

L'Économie des Sessions Éphémères

Le système abandonne délibérément toute base de données persistante. L'argument : moins de 5% des visiteurs reviennent, donc pourquoi stocker leurs données ? Si un client interrompt sa session, toutes les informations disparaissent sans possibilité de récupération.

Cette approche radicale réduit les coûts d'infrastructure mais crée une expérience utilisateur frustrante. Un client qui revient après réflexion doit tout recommencer. Cette philosophie du "jetable" contraste avec les standards actuels du service client, où la continuité des échanges constitue un avantage compétitif.

L'absence de files d'attente côté serveur signifie également qu'aucun mécanisme ne gère les pics de charge. Le système fonctionne ou échoue en temps réel, sans dégradation progressive. Cette fragilité architecturale rappelle les premières expériences avec les agents conversationnels grand public.

Le Paradoxe de l'Expertise Sans Transmission

Le créateur affirme vouloir "opérer avec un réseau de professionnels expérimentés" en éliminant les postes juniors. Cette stratégie ignore une question fondamentale : comment ces experts ont-ils acquis leur expérience ? La réponse inévitable : en occupant précisément les postes que l'IA est censée remplacer.

L'architecte qui a testé le système a posé cette question directement : "Comment allez-vous former les jeunes architectes si les chatbots font leur travail ?" L'agent a esquivé en parlant de "brûler la pyramide". Cette absence de réponse reflète une incohérence stratégique : un modèle économique qui détruit ses propres fondations à moyen terme.

Ce phénomène s'observe dans d'autres secteurs où l'IA délègue paradoxalement à des humains les tâches qu'elle ne maîtrise pas, créant un marché du travail fragmenté.

Le Coût Réel de la Non-Spécialisation

Lors des tests communautaires, l'agent a fourni du code Python pour calculer Pi, un itinéraire touristique à Vancouver, et des informations sur l'enrichissement d'uranium. Ces dérives montrent l'absence de garde-fous robustes. Un système conçu pour conseiller sur l'architecture répond à tout et n'importe quoi, diluant sa valeur spécialisée.

Le créateur reconnaît avoir "focalisé sur la logique métier AEC sans suffisamment de barrières générales". Cette admission révèle une approche amateur du développement d'agents IA, où les contraintes de sécurité arrivent après coup plutôt que par conception.

L'Illusion de l'Autonomie Totale

Le système se présente comme un remplacement complet du travail junior, mais les logs montrent une réalité différente. Lorsque la complexité technique augmente, l'agent redirige vers un formulaire de contact humain. Cette "béquille" révèle que l'automatisation n'est que partielle.

L'agent ne peut pas fournir d'études de cas vérifiables, de références tierces ou de preuves de réalisations concrètes. Interrogé sur ce point, il répond par du marketing creux : "Notre travail repose sur la confidentialité et les relations directes." Cette absence de validation externe mine la crédibilité du modèle.

Les limites de ces systèmes apparaissent clairement quand on les compare à des projets IA véritablement autonomes capables de produire des résultats vérifiables sans intervention humaine.

Les Leçons Pour les Entrepreneurs Français

Ce cas d'usage illustre plusieurs erreurs courantes dans l'adoption de l'IA par les PME :

- Confondre automatisation et amélioration : Remplacer un site statique par un chatbot agressif n'améliore pas nécessairement l'expérience client

- Négliger la conformité dès la conception : Les problèmes RGPD et de responsabilité juridique auraient dû être adressés avant le déploiement

- Optimiser pour les mauvaises métriques : Réduire les coûts d'hébergement à zéro ne crée pas de valeur si le taux de conversion s'effondre

- Sous-estimer la complexité technique : Un développeur qui n'a pas codé depuis 30 ans ne devrait pas gérer seul un système client-facing critique

L'approche "bricolage guidé par l'IA" peut fonctionner pour des prototypes, mais expose l'entreprise à des risques démesurés pour un gain hypothétique. Les startups IA françaises performantes investissent massivement dans la sécurité et la conformité avant la mise en production.

Vers une Approche Plus Équilibrée

L'IA conversationnelle a sa place dans le service client, mais pas comme remplacement total de l'humain. Les systèmes les plus efficaces en 2026 combinent :

- Filtrage initial automatisé : L'IA qualifie les demandes et collecte les informations de base

- Escalade intelligente : Transfert rapide vers un humain dès que la complexité dépasse un seuil prédéfini

- Apprentissage supervisé : Les conversations sont revues par des experts qui corrigent les erreurs

- Transparence claire : Les utilisateurs savent qu'ils parlent à une IA et peuvent demander un humain à tout moment

Cette approche hybride préserve les emplois juniors tout en libérant du temps expert pour les tâches à haute valeur. Elle évite également les pièges juridiques d'une délégation aveugle à l'IA. Les outils comme les systèmes de vérification collaborative montrent qu'IA et humains fonctionnent mieux ensemble que séparément.

L'Avenir des Agents IA en France

Le marché français des agents conversationnels devrait atteindre 2,3 milliards d'euros en 2027 selon les dernières projections. Mais cette croissance sera portée par des solutions professionnelles respectant les normes européennes, pas par des prototypes artisanaux exposant leurs utilisateurs à des risques juridiques.

Les régulateurs français examinent actuellement plusieurs cas de responsabilité liés aux erreurs d'IA. Un cabinet d'architecture poursuivi pour des conseils erronés fournis par un chatbot créerait un précédent qui refroidirait tout le secteur. La prudence reste de mise.

Pour les professionnels souhaitant expérimenter avec l'IA, la voie la plus sûre passe par des plateformes établies offrant des garanties contractuelles. Des solutions comme les infrastructures IA professionnelles assument la responsabilité technique et juridique, permettant aux entrepreneurs de se concentrer sur leur métier.

L'expérience décrite ici constitue un avertissement utile : l'IA n'est pas une baguette magique qui dispense de réfléchir à la stratégie commerciale, à l'éthique professionnelle et à la conformité réglementaire. Elle amplifie les décisions humaines, bonnes comme mauvaises.