Les agents conversationnels basés sur l'intelligence artificielle transforment la relation client, mais leur déploiement pose un défi majeur : comment garantir leur fiabilité avant la mise en production ? Contrairement aux applications traditionnelles, ces systèmes autonomes peuvent générer des milliers de chemins conversationnels différents. Cekura, une startup issue de Y Combinator, propose une solution innovante de tests et de surveillance spécifiquement conçue pour ces agents IA.

Le défi du contrôle qualité pour les agents conversationnels IA

Tester manuellement un agent IA s'avère pratiquement impossible. Lorsqu'une équipe modifie un prompt, change de modèle de langage ou ajoute une fonctionnalité, elle ne peut pas anticiper toutes les interactions utilisateurs possibles. Les méthodes classiques montrent rapidement leurs limites.

La vérification manuelle ne passe pas à l'échelle, attendre les plaintes utilisateurs arrive trop tard, et les tests scriptés traditionnels restent trop rigides. Cette problématique concerne aussi bien les modèles de raisonnement avancés que les systèmes conversationnels plus simples.

Les limites des approches conventionnelles

Les plateformes de traçage comme Langfuse ou LangSmith excellent pour déboguer des appels LLM individuels, mais elles passent à côté d'un type de défaillance crucial : les erreurs qui surviennent dans l'enchaînement des tours de conversation. Prenons l'exemple d'un processus de vérification bancaire nécessitant nom, date de naissance et numéro de téléphone. Si l'agent oublie de demander la date de naissance, chaque interaction isolée semble correcte, mais le flux global est défaillant.

La simulation conversationnelle : une approche systématique

Cekura repose sur un principe fondamental : des utilisateurs synthétiques interagissent avec l'agent exactement comme le feraient de vrais utilisateurs. Des juges basés sur des LLM évaluent ensuite si les réponses sont appropriées, non pas tour par tour, mais sur l'ensemble de l'arc conversationnel.

Génération de scénarios et importation de conversations réelles

La plateforme génère automatiquement une suite de tests à partir d'une simple description de l'agent. Mais les vrais utilisateurs empruntent souvent des chemins qu'aucun générateur ne peut anticiper. Cekura ingère donc les conversations de production et en extrait automatiquement des cas de test. Cette approche garantit que la couverture évolue avec les comportements utilisateurs réels.

Cette méthodologie rappelle l'importance de comprendre les comportements réels des utilisateurs pour optimiser tout système basé sur l'IA.

Plateforme de simulation d'outils

Les agents conversationnels appellent fréquemment des outils externes. Exécuter des simulations contre de vraies API s'avère lent et instable. La plateforme de mock tools de Cekura permet de définir des schémas d'outils, des comportements et des valeurs de retour. Les simulations testent ainsi la sélection d'outils et la prise de décision sans toucher aux systèmes de production.

| Approche | Avantages | Inconvénients |

|---|---|---|

| Tests manuels | Compréhension humaine du contexte | Ne passe pas à l'échelle, coûteux |

| Scripts traditionnels | Reproductibles | Trop rigides, ne capturent pas la variabilité |

| Traçage tour par tour | Détecte les erreurs LLM individuelles | Rate les défaillances conversationnelles globales |

| Simulation Cekura | Évalue les sessions complètes, déterministe | Nécessite configuration initiale |

Tests déterministes malgré la nature stochastique des LLM

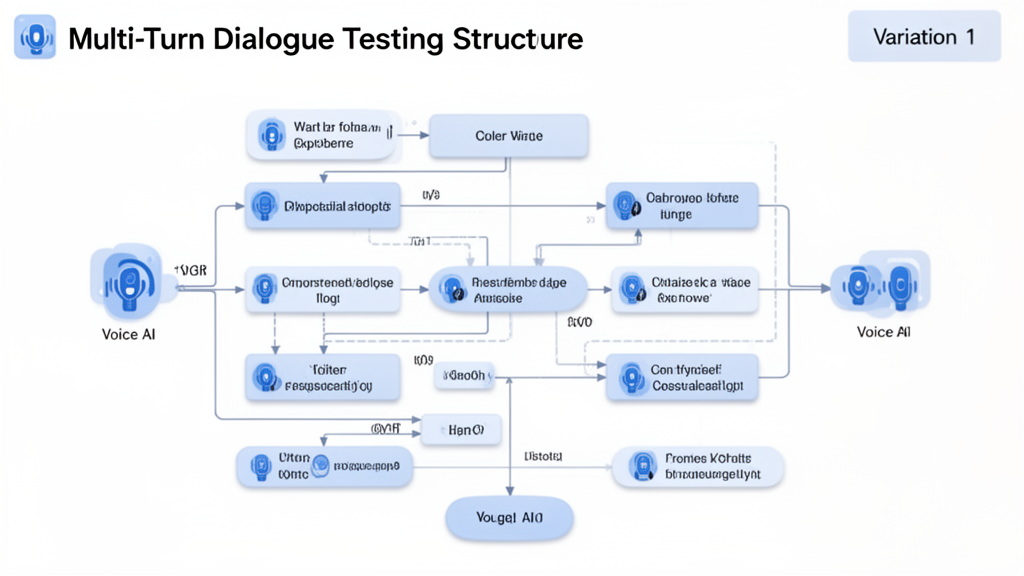

Les modèles de langage sont par nature probabilistes. Un test d'intégration continue qui réussit "la plupart du temps" ne sert à rien. Plutôt que des prompts en texte libre, les évaluateurs Cekura sont définis comme des arbres d'actions conditionnelles structurés.

Ces conditions explicites déclenchent des réponses spécifiques, avec support pour des messages fixes lorsque la précision mot à mot compte. L'utilisateur synthétique se comporte donc de manière cohérente entre les exécutions : même logique de branchement, mêmes entrées. Une défaillance signale une vraie régression, pas du bruit aléatoire.

Architecture des cas de test structurés

Cette approche structurée contraste avec la flexibilité nécessaire dans d'autres domaines de l'IA. Alors que certains chercheurs explorent des modèles au-delà des LLM, Cekura exploite intelligemment leurs capacités tout en compensant leur variabilité.

Les cas de test incluent :

- Des conditions d'entrée précises définissant le contexte utilisateur

- Des chemins de conversation attendus avec points de branchement

- Des critères de succès mesurables pour chaque session

- Des assertions sur l'état final après l'interaction complète

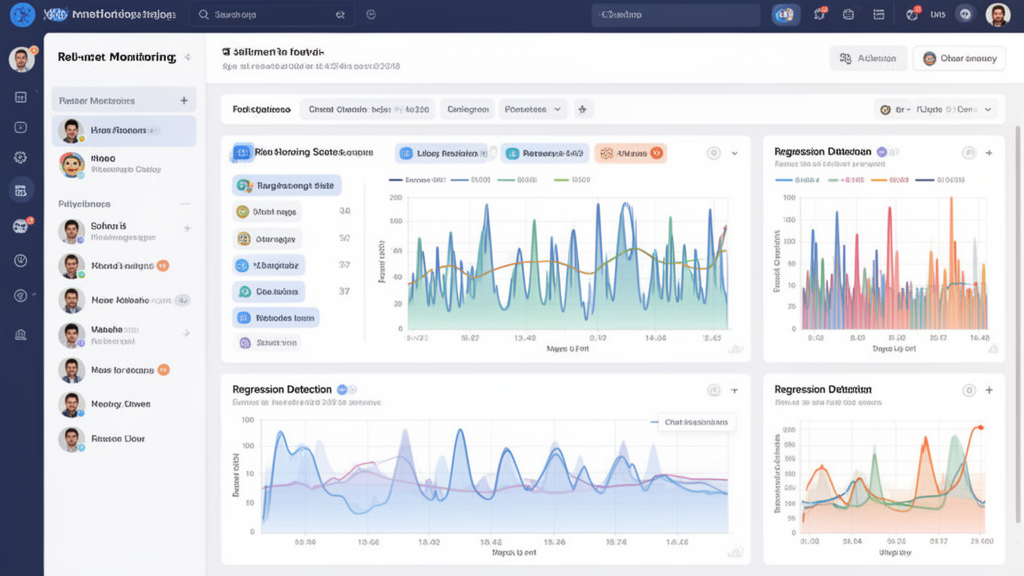

Surveillance en temps réel des agents en production

Au-delà des tests pré-déploiement, Cekura surveille le trafic des agents en direct. La différence fondamentale avec les plateformes de traçage traditionnelles réside dans l'évaluation au niveau de la session complète plutôt que tour par tour.

Détection des défaillances conversationnelles globales

Imaginons un agent bancaire où l'utilisateur échoue à la vérification à l'étape 1, mais l'agent hallucine et poursuit quand même. Un évaluateur basé sur les tours voit l'étape 3 (confirmation d'adresse) et la marque comme réussie : la bonne question a été posée. Le juge de Cekura examine la transcription complète et signale la session comme échouée car la vérification n'a jamais abouti.

Cette capacité à détecter les problèmes contextuels devient cruciale alors que l'IA s'intègre dans des domaines sensibles où la fiabilité est primordiale.

Corrélation entre simulations et données de production

Cekura suit directement les modes de défaillance en production plutôt que de s'appuyer uniquement sur la simulation. Si un mode de défaillance apparaît soudainement trop fréquemment, le système alerte immédiatement. Cette approche évite les retours d'information retardés.

La surveillance en production permet également de rejouer les conversations pour s'assurer que les régressions sont bien gérées. Cette boucle de rétroaction continue améliore progressivement la robustesse de l'agent.

Cas d'usage et intégration technique

Cekura prend en charge différents types d'agents conversationnels, des agents vocaux aux chatbots textuels, en passant par les systèmes SMS et WhatsApp. L'intégration se fait soit via API exposée, soit par connexion directe aux fournisseurs d'agents conversationnels.

Gestion des flux incomplets et escalades

Comment gérer les sessions où le résultat correct est un flux incomplet ? Par exemple, lorsque l'agent refuse correctement d'avancer parce que l'appelant a échoué à la vérification, ou escalade correctement vers un humain ? L'architecture de Cekura, consciente du contexte de l'agent, permet aux agents de test de connaître ces flux incomplets. Les assertions sont définies par session.

Cette granularité dans l'évaluation s'avère essentielle, notamment pour les applications nécessitant une conformité légale stricte où chaque décision doit être traçable et justifiable.

Intégration des bases de connaissances

Les agents vocaux nécessitent souvent une intégration avec des bases de connaissances. Cekura supporte déjà les intégrations BigQuery et prévoit d'élargir l'ensemble des connecteurs. Les utilisateurs peuvent également déposer directement des fichiers de connaissances. La plateforme génère même des scénarios à partir de ces bases de connaissances.

Tarification et accessibilité

Cekura propose un essai gratuit de 7 jours sans carte bancaire requise. Les formules payantes démarrent à 30 euros par mois, rendant la solution accessible aux startups comme aux entreprises établies.

Cette accessibilité s'inscrit dans une tendance plus large où les outils IA deviennent plus abordables, permettant à davantage d'organisations d'adopter ces technologies.

Comparaison avec les alternatives

Plusieurs développeurs ont créé leurs propres solutions de test pour agents vocaux. Certains utilisent Playwright avec des périphériques virtuels alimentés par Pulseaudio, connectant TTS et STT pour permettre l'automatisation end-to-end. D'autres s'appuient sur des frameworks comme Livekit ou Pipecat avec des injections de réponses textuelles.

Cekura se distingue par son approche intégrée : plutôt que d'exiger que chaque équipe construise son infrastructure de test, la plateforme fournit une solution clé en main qui s'intègre aux frameworks existants.

Perspectives d'évolution et défis à relever

Un défi persistant dans les tests d'agents IA concerne le "sens commun" : les agents peuvent observer quelque chose qu'un humain trouverait immédiatement déplacé ou manifestement incorrect, sans lever de drapeau rouge. Cette limitation des agents utilisés pour vérifier d'autres agents reste un domaine de recherche actif.

Architectures multi-agents et mémoire épisodique

Certaines équipes expérimentent avec des architectures de type "cerveau rapide, cerveau lent" ou des orchestrateurs d'agents avec reconnaissance d'intention qui routent vers différents sous-agents. Ces approches montrent un succès prometteur.

L'entraînement via mémoire épisodique avec systèmes de rétroaction représente une autre piste. Cette formation est récupérée lors de situations similaires ultérieures. Toutefois, l'entraînement complet reste excessif pour la plupart des cas d'usage actuels. Les agents fonctionnent bien avec des boucles de rétroaction, des outils appropriés et l'optimisation des prompts.

Ces évolutions architecturales font écho aux innovations dans la puissance de calcul dédiée à l'IA, permettant des systèmes toujours plus sophistiqués.

Sélection d'outils et logique de décision

La plateforme de mock tools permet de vérifier que les outils retournent les bonnes données, mais comment détecter lorsque l'agent appelle le mauvais outil ? Par exemple, un agent support qui appellerait l'outil "rembourser commande" alors que l'utilisateur souhaite simplement vérifier le statut de sa commande.

L'outil fonctionne parfaitement, mais le LLM choisit le mauvais. Une solution consiste à créer des sous-agents spécialisés, comme un sous-agent de remboursement responsable de vérifier si l'utilisateur demande vraiment un remboursement avant d'exécuter ces actions sensibles. Cela minimise les erreurs, même si les LLM restent non déterministes par nature.

Pour aller plus loin dans l'optimisation de vos agents conversationnels et découvrir comment Roboto peut vous aider à générer du contenu IA de qualité, créez votre compte gratuit sur Roboto et explorez nos outils de génération assistée par intelligence artificielle.