L'essor des modèles de langage (LLM) comme Claude, GPT-4 et Gemini 3 transforme profondément les pratiques de développement logiciel. Une tendance particulièrement marquante émerge en 2026 : la multiplication des microservices dans les architectures applicatives. Cette évolution n'est pas anodine et répond à des besoins concrets lorsque l'on code avec l'assistance d'intelligences artificielles. Mais cette fragmentation architecturale est-elle vraiment bénéfique pour nos projets ?

Pourquoi les LLM favorisent naturellement les microservices

Le développement assisté par IA présente une caractéristique fondamentale : les modèles de langage excellent dans la manipulation de contextes bien délimités. Un microservice, par sa nature même, offre exactement ce type d'environnement contrôlé. Contrairement à un monolithe où les dépendances s'entremêlent, un microservice possède une surface d'interaction clairement définie.

Lorsqu'un développeur utilise Claude ou ChatGPT pour refactoriser du code, le risque d'effets de bord diminue considérablement dans une architecture microservices. Les requêtes entrantes, les réponses sortantes et les webhooks constituent des contrats explicites. Tant que ces interfaces restent stables, l'IA peut remanier l'intégralité du code interne sans compromettre le système global.

Cette approche rappelle celle des frameworks modernes comme Django qui privilégient la modularité. Un microservice peut disposer de sa propre base de données, de ses systèmes de cache et de son stockage d'objets. L'appelant externe n'a pas besoin de connaître ces détails d'implémentation.

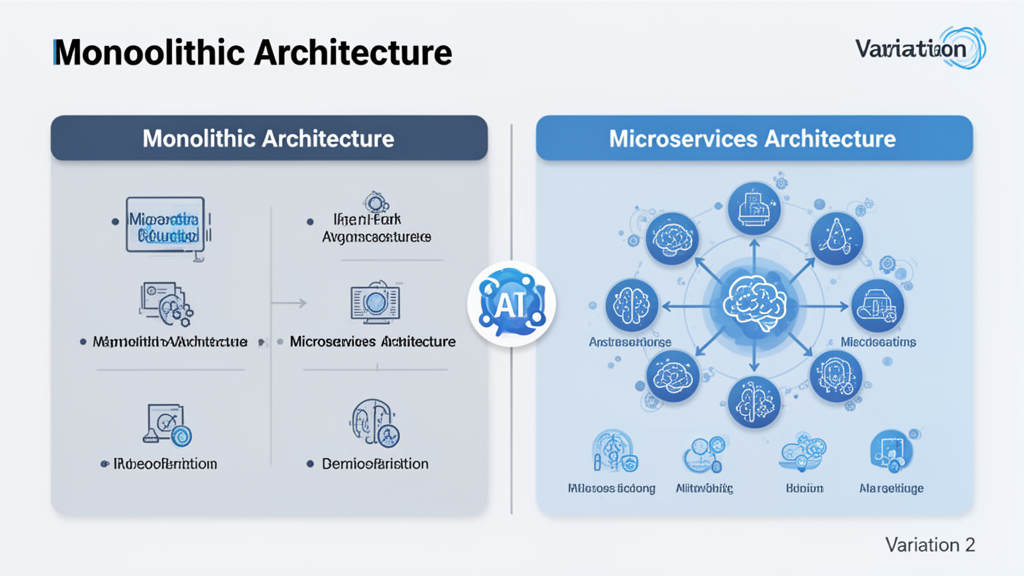

Les risques du couplage implicite dans les monolithes

Le développement dans une application monolithique impose une vigilance constante. L'ordre d'exécution des opérations, le nommage des clés de cache ou la structure des données partagées créent des dépendances invisibles. Ces couplages implicites représentent un danger réel lorsqu'on confie des refactorisations massives à une IA.

Un développeur expérimenté peut anticiper ces interdépendances, mais ses collègues moins rigoureux introduisent parfois des raccourcis qui fragilisent l'architecture. Les LLM, malgré leur puissance, ne détectent pas toujours ces subtilités contextuelles qui ne figurent pas explicitement dans le code.

Les microservices réduisent drastiquement ce risque de couplage accidentel. Chaque service fonctionne comme une boîte noire autonome. Même si l'IA génère du code imparfait à l'intérieur, les frontières architecturales limitent la propagation des erreurs. Cette isolation permet d'expérimenter plus librement avec des assistants IA comme Grok 3 sans mettre en péril l'ensemble du système.

Les avantages organisationnels des microservices avec l'IA

Au-delà des considérations techniques, les microservices offrent des bénéfices organisationnels significatifs dans un contexte de développement assisté par IA. Ces avantages expliquent pourquoi cette architecture devient le chemin de moindre résistance pour de nombreuses équipes.

Processus de révision simplifié

Un microservice hébergé dans un dépôt GitHub distinct échappe souvent à la scrutinisation intensive des pull requests. Cette autonomie permet aux développeurs d'itérer rapidement, parfois en commitant directement sur la branche principale. Lorsqu'on génère du code avec une IA, cette vélocité accrue facilite l'expérimentation et l'ajustement des prompts.

Accès facilité aux ressources de production

Les bases de données principales des applications critiques sont généralement verrouillées pour des raisons de sécurité. Les ingénieurs standard y accèdent difficilement. En revanche, l'infrastructure d'un microservice secondaire bénéficie de restrictions moins strictes. Cette accessibilité simplifie le débogage et l'optimisation lorsqu'on teste des solutions générées par IA.

Un microservice dédié à la génération d'images ou de vidéos, par exemple, peut intégrer les dernières avancées en IA générative sans impacter les systèmes critiques. Cette séparation encourage l'innovation tout en préservant la stabilité.

Le revers de la médaille : complexité et maintenance

Malgré leurs atouts, les microservices introduisent une complexité opérationnelle considérable à long terme. La prolifération de dizaines de services indépendants crée un écosystème difficile à superviser et à maintenir.

| Aspect | Monolithe | Microservices multiples |

|---|---|---|

| Gestion des comptes | Centralisée | Dispersée (risque d'oubli) |

| Configuration hébergement | Unique | Multiple (Vercel, AWS, etc.) |

| Facturation | Simplifiée | Complexe (multiples fournisseurs) |

| Surveillance | Centralisée | Nécessite agrégation |

| Mises à jour | Coordonnées | Désynchronisées |

Chaque microservice possède ses propres dépendances, ses clés API et ses ressources cloud. Un service de génération d'images hébergé sur Vercel peut utiliser une API OpenAI dont le renouvellement d'abonnement passe inaperçu jusqu'à ce que le service cesse brutalement de fonctionner.

Cette fragmentation rappelle les défis rencontrés dans la gestion d'erreurs JavaScript distribuées : la multiplication des points de défaillance complique le diagnostic et la résolution des problèmes.

Stratégies pour équilibrer agilité et maintenabilité

Face à cette tension entre les avantages immédiats des microservices et leurs coûts de maintenance, plusieurs stratégies émergent pour les équipes développant avec l'assistance d'IA.

Établir des garde-fous architecturaux

Plutôt que d'interdire les microservices, il convient de définir des critères clairs justifiant leur création. Un nouveau service ne devrait voir le jour que s'il répond à des besoins spécifiques : isolation de ressources critiques, scalabilité indépendante ou séparation de domaines métier distincts.

Centraliser la gestion des ressources

Les outils d'Infrastructure as Code (Terraform, Pulumi) permettent de maintenir une visibilité sur l'ensemble des ressources déployées. Cette centralisation devient cruciale lorsque les organisations multiplient les services IA pour différents cas d'usage.

Standardiser les patterns de développement

L'utilisation de templates et de générateurs de code facilite la création de microservices conformes aux bonnes pratiques. Lorsqu'un développeur lance un nouveau service, il devrait hériter automatiquement de configurations standardisées pour le monitoring, la journalisation et la sécurité.

- Templates de démarrage incluant observabilité et sécurité

- Pipelines CI/CD préconfigurés pour déploiement automatisé

- Documentation générée automatiquement à partir des contrats d'API

- Dashboards de monitoring agrégés pour tous les services

- Politiques de rétention et d'archivage des logs harmonisées

L'avenir du développement assisté par IA

La relation entre développement assisté par IA et architecture microservices soulève des questions fondamentales sur l'évolution de nos pratiques. Si les LLM favorisent naturellement cette fragmentation, c'est peut-être le signe que nos outils et processus doivent évoluer.

Les prochaines générations d'assistants IA devront mieux comprendre les architectures complexes et les dépendances implicites. Des modèles capables d'analyser l'ensemble d'un monolithe tout en préservant sa cohérence permettraient de retrouver les avantages de simplicité sans sacrifier la puissance de l'IA.

Parallèlement, les frameworks et plateformes évoluent pour faciliter le développement modulaire sans fragmentation excessive. Les architectures "modulithes" combinent la simplicité opérationnelle du monolithe avec les frontières claires des microservices.

Cette réflexion architecturale s'inscrit dans un contexte plus large où l'IA influence profondément nos méthodes de travail. Comme pour tout outil puissant, l'essentiel réside dans l'équilibre entre exploitation de ses capacités et maîtrise de ses implications.

Recommandations pratiques pour les équipes de développement

Pour tirer parti des LLM sans subir les inconvénients d'une prolifération incontrôlée de microservices, voici quelques recommandations concrètes :

- Auditer régulièrement : Inventorier trimestriellement tous les services déployés, leurs coûts et leur utilisation réelle

- Définir des seuils : Établir des critères quantifiables (charge, latence, domaine métier) justifiant la création d'un nouveau service

- Documenter les contrats : Utiliser OpenAPI/Swagger pour spécifier explicitement toutes les interfaces, facilitant le travail des IA

- Automatiser la conformité : Intégrer des vérifications automatiques garantissant que chaque service respecte les standards de sécurité et d'observabilité

- Former les équipes : Sensibiliser les développeurs aux implications à long terme de leurs choix architecturaux, même lorsque l'IA accélère l'implémentation

Ces pratiques s'appliquent que vous développiez des applications web classiques ou que vous intégriez des solutions IA spécialisées dans votre écosystème.

Conclusion : Vers une architecture consciente

Le développement assisté par IA pousse naturellement vers les microservices en raison de leurs frontières explicites et de leur isolation. Cette tendance offre des avantages indéniables : vélocité accrue, expérimentation facilitée et risques contenus lors des refactorisations massives. Cependant, la multiplication incontrôlée de services indépendants génère une dette opérationnelle considérable.

L'enjeu pour les équipes en 2026 consiste à trouver le juste équilibre. Plutôt que de suivre aveuglément le chemin de moindre résistance, il faut construire des processus et des outils rendant les bonnes pratiques aussi accessibles que les solutions rapides. L'architecture logicielle ne devrait pas être dictée par les limitations de nos assistants IA, mais par les besoins réels de nos applications et de nos utilisateurs.

Les organisations qui réussiront cette transition seront celles qui sauront exploiter la puissance des LLM tout en maintenant une vision cohérente de leur architecture globale. Cette maîtrise passe par l'éducation, l'outillage et une culture technique valorisant la maintenabilité autant que la rapidité de développement.

Pour aller plus loin dans l'utilisation intelligente de l'IA dans vos projets de développement, créez votre compte gratuit sur Roboto et découvrez comment générer du contenu technique de qualité tout en gardant le contrôle sur votre architecture.